Conference Debriefing (5b): Wie gefährlich sind Big Data, Künstliche Intelligenz und Algorithmen für den Wettbewerb?

Gestern berichtete Anja Rösner vom DICE hier im Blog über eine Konferenz in Brüssel. Die steigende Bedeutung von „Big Data“, künstlicher Intelligenz und Algorithmen hat ja eine intensive Debatte über die Implikationen für das Wettbewerbsrecht und eine Flut an Konferenzen ausgelöst. Heute berichtet Adrian Deuschle vom Lehrstuhl Podszun wie in Hamburg die Diskussion steht.

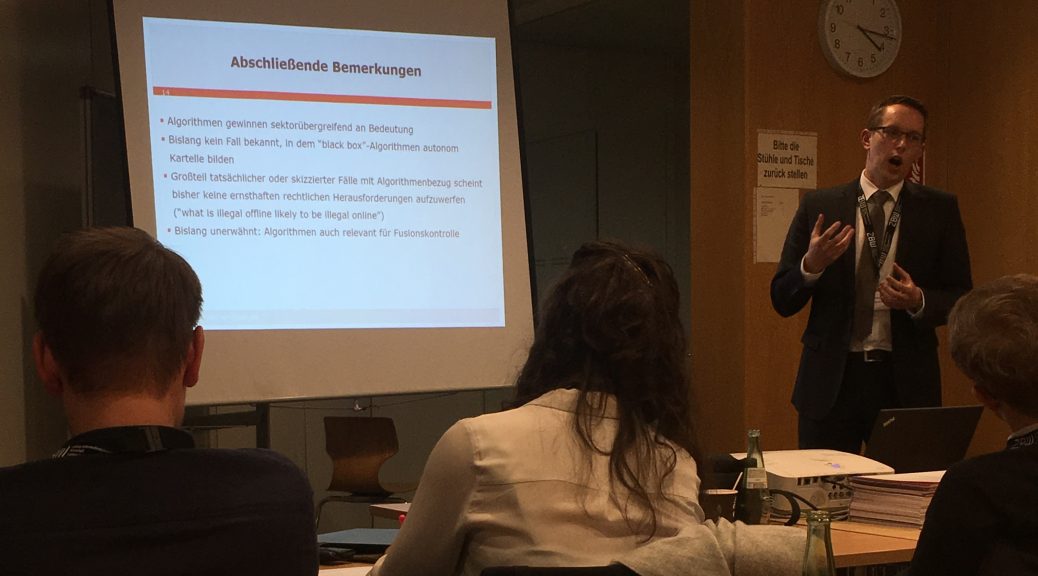

Konferenzname: Algorithmen, Künstliche Intelligenz und Wettbewerb

Ort & Zeit: Helmut-Schmidt-Universität der Bundeswehr Hamburg (HSU), 23.11.2018

Gastgeber: Das Hamburger Forum Medienökonomie (hfm) unter Leitung von Prof. Dr. Ralf Dewenter von der HSU und Prof. Dr. Ulrich Schwalbe von der Universität Hohenheim

Teilnehmer: Wettbewerbsökonomen, Kartellrechtler und Informatiker.

Algorithmen? Was kann man darunter eigentlich verstehen?

Algorithmen, Künstliche Intelligenz und Wettbewerb.

Wie wir wissen, wissen die Deutschen nichts kaum etwas über Algorithmen. Daher war es besonders lehrreich, dass Dr. Daniel Hennes, Lehrstuhlvertreter für maschinelles Lernen und Robotik an der Universität Stuttgart, erstmal erklärte wie Algorithmen und künstliche Intelligenz funktionieren. Die mathematischen Formeln, die hinter den Algorithmen stecken, erspare ich Ihnen an dieser Stelle. Die Komplexität von Preisalgorithmen variiert sehr stark. Es gibt sehr einfache Algorithmen, die auf simplen heuristischen Regeln beruhen. Auf der anderen Seite gibt es hochkomplexe neuronale Netze die sich mit der Zeit verändern können, je nachdem welchen Input sie bekommen. Diese Algorithmen nutzen maschinelles Lernen um sich weiterzuentwickeln. Bei vielen preissetzenden Algorithmen wird „reinforcement learning“ oder zu Deutsch „bestärkendes Lernen“ angewendet.

Reinforcement steht dabei für Lernen durch Versuch und Irrtum und Learning für Darstellung, Bewertung und Optimierung. Verhaltensmuster, die einen hohen Gewinn erzielen, werden bestärkt und weniger erfolgreiches Verhalten wird abgeschwächt. Reinforcement learning wurde in der Vergangenheit sehr erfolgreich genutzt um in Spielen wie Poker, Schach oder dem noch komplexeren GO zu äußerst effektiven Ergebnissen zu kommen. Maximilian Bank, der CEO von Patagona, stellte in seinem Vortrag über Preisoptimierung im Online-Handel ein eher einfaches Tool für Online Händler und Hersteller zum Repricing und Dynamic Pricing vor. Bei der Verwendung von Dynamic Pricing bekommt jeder Kunde einen individuellen Preis angezeigt. Es handelt sich dabei laut Bank um einen experimentellen Ansatz, der bei den iPad-Besitzern unter den Verbrauchern eher wenig Akzeptanz genießt. Repricing dagegen bedeutet einen Preis für alle, der bei Amazon innerhalb von 5-10 Minuten und bei Ebay und anderen Vergleichsseiten ein bis vier Mal täglich verändert werden kann.

Interessant! Aber was hat das mit Kartellrecht zu tun?

Unter Wettbewerbshütern geht die Angst um, dass preissetzende Algorithmen durch die Beobachtung der Preise von Konkurrenten, die auch von Algorithmen festgelegt werden, innerhalb von kürzester Zeit eine Koordination erreichen. Dies könnte zu Kartellpreisen führen, die den Gewinn aller Unternehmen im Markt zu Lasten der Verbraucher maximieren. Allerdings verbietet das Kartellverbot nur explizite, nicht aber implizite Koordinierung. Werden Algorithmen also nur als Hilfsfunktionen verwendet wie bei Topkins bzw. dem britischen Poster Fall, können wir mit den bestehenden gesetzlichen Regelungen arbeiten. Ein bewusstes Parallelverhalten wie im Tankstellenkartell ist nicht vom Anwendungsbereich erfasst. Kim Manuel Künstner von Schulte Riesenkampff stellte in seinem Vortrag daher die relevante Frage, ob Algorithmen aus jedem Markt einen Tankstellenmarkt machen können. Dazu müssten die Algorithmen aber ohne entsprechende Programmierung kollusiv zusammenwirken.

Ist eine vollständig automatische algorithmische Kollusion tatsächlich möglich oder handelt es sich um „legal sci-fi“?

Das ist die Gretchenfrage in dieser Diskussion, der sich Prof. Schwalbe in seinem Vortrag annahm. Selbstlernende Algorithmen sind sehr erfolgreich in Spielen wie Poker, GO und Schach. Diese Algorithmen sind aber hochspezialisiert. Sie arbeiten in einfachen, deterministischen Umgebungen mit festen, klar definierten Regeln. Wenn sich die Umgebung oder die Regeln ändern, können die Algorithmen das erlernte Verhalten nicht einfach übertragen. Ein neuer Lernprozess ist nötig. Komplexe Märkte mit vielen Teilnehmern, zahlreichen Strategien und unvollständigen Informationen sind für Algorithmen eine Herausforderung. Ob Algorithmen auf Märkten zu einem kollusiven Marktergebnis kommen, wurde von Ökonomen in zahlreichen Studien erforscht.

Das Ergebnis: ein kollusives Verhalten der Algorithmen ist möglich, aber nicht das einzige Ergebnis. Komplexere Algorithmen tendieren eher zu einem nicht kooperativen Verhalten. Zu einer stillschweigenden Abstimmung (tacit collusion) kommt es nur unter ganz bestimmten Bedingung. Zwei Firmen möglichst derselben Größe agieren auf einem Markt mit einer symmetrischen Kostenstruktur, Produktpalette und homogenen Produkten. Das sind aber die gleichen Bedingungen, unter denen auch jetzt schon typischerweise stillschweigende Abstimmungen entstehen. Das ist also kein spezifisches Problem des Einsatzes von Algorithmen. Die Gefahr einer stillschweigenden Vereinbarung wäre deutlich höher, wenn die Algorithmen in der Lage wären untereinander zu kommunizieren. Das ist grundsätzlich möglich, die Forschung hierzu steckt aber noch in den Kinderschuhen. Im Ergebnis hielt Ulrich Schwalbe somit fest, dass ein kollusives Zusammenwirken von Algorithmen nach derzeitigem Stand der Forschung zwar möglich ist, aber nicht so wahrscheinlich oder unvermeidlich wie in vielen Beiträgen suggeriert wird.

Es ging also nur um kollusives Zusammenwirken von Algorithmen?

Nein! Sebastian Wismer vom Bundeskartellamt, das im Juni ein gemeinsames Projekt mit der französischen Wettbewerbsbehörde zu Algorithmen und deren Auswirkungen auf den Wettbewerb gestartet hat, problematisierte den Zugang zu bzw. der Nutzung von Algorithmen als Marktmachtfaktor. In der Tat könnten Amazon, Google und Co. mit ihren deep pockets einen Wettbewerbsvorteil bei der Erstellung smarter Algorithmen haben. Durch überlegene Algorithmen könnte die Marktmacht weiter zementiert werden. Die Verweigerung des Zugangs von Algorithmen könnte missbräuchliche Verhaltensweisen unterstützen. Zudem könnten Preissetzungsalgorithmen missbräuchlich eingesetzt werden. Im Lufthansa-Verfahren hatte das Bundeskartellamt bei einer Preissteigerung von 25-30 % noch davon abgesehen, ein Missbrauchsverfahren einzuleiten. Ebenso könnte die Verwendung von Dynamic Pricing im Verhältnis B2C einen Ausbeutungsmissbrauch und im Verhältnis B2B einen Behinderungsmissbrauch darstellen.

Muss das Kartellrecht aufgrund der drohenden Gefahren durch Algorithmen angepasst werden?

Diese Frage stellte Dr. Daniel Fülling vom BMWi in die Runde und gab die Gelegenheit, Einfluss auf die 10. GWB-Novelle zu nehmen. Die Reaktionen des Publikums waren verhalten. Ich habe das Gefühl, dass die Gefahr, die von Algorithmen ausgeht, immer noch nicht hundertprozentig greifbar ist. Ein frühzeitiger Eingriff des Gesetzgebers könnte die positiven Effekte von Algorithmen untergraben. Allerdings muss die Anwendbarkeit des GWB gewährleistet sein. Daher könnte man überlegen, ob auch eine implizite Koordination durch Algorithmen in den Anwendungsbereich des Kartellverbots fallen muss. Da die Gefahr von impliziter Kollusion derzeit noch nicht besonders hoch ist, besteht kein dringender Handlungsbedarf. Weiterhin ungeklärt ist die Haftungsfrage. Wer haftet im Falle eines autonomen Verstoßes von Algorithmen gegen das Kartellrecht? Zwar werden laut Andreas Mundt die „Algorithmen nicht im Himmel vom lieben Gott geschrieben“. Für Softwareentwickler wäre es aber durchaus interessant, unter welchen Voraussetzungen sie im Falle eines Kartellschadens in die Haftung miteinbezogen werden.

Gibt es auch Lösungen außerhalb des GWB?

Ja, und auch diese wurden rege diskutiert. Zunächst könnte man über Marktlösungen nachdenken. So könnten die Verbraucher einen eigenen Algorithmus einsetzen um der Koordination der Anbieter entgegen zu wirken. Klaus Holthoff-Frank von der Monopolkommission äußerte solchen Vorschlägen gegenüber Bedenken, da im Wettlauf um die besten Daten die Verbraucher im Zweifel schlechter abschneiden. In Betracht kommt überdies eine Regulierung von Preissetzungsalgorithmen. Offenlegungspflichten und Vorgaben für Programmcodes könnten aber die Anreize für Investitionen und Innovationen mindern. Es bleibt also wie immer: Der Markt allein kann es nicht, Regulierung wollen wir nicht, also muss das Kartellrecht ran.